robots.txt:如何让搜索引擎不要抓取没用的页面

发布时间:2022-08-25 21:32:19 所属栏目:网络游戏 来源:

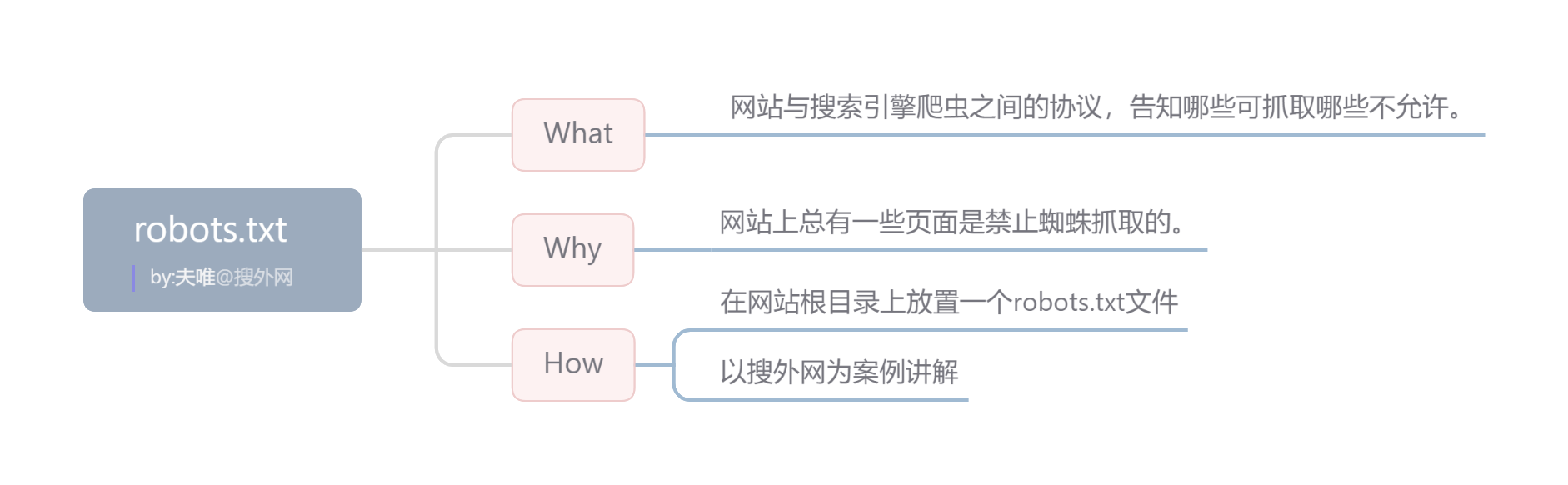

导读:| 什么是robots文件?Robots是站点与spider沟通的重要渠道,是网站与搜索引擎爬虫之间的协议,告知哪些可抓取哪些不允许。| 为什么要做robots文件?网站上总有一些页面是禁止蜘蛛抓取的。例如:搜索页面、筛选页面、

|

| 什么是robots文件? Robots是站点与spider沟通的重要渠道,是网站与搜索引擎爬虫之间的协议,告知哪些可抓取哪些不允许。 | 为什么要做robots文件? 网站上总有一些页面是禁止蜘蛛抓取的。例如:搜索页面、筛选页面、后台登录地址等。 | 如何制作 robots文件? 编写robots.txt文件并上传到网站根目录。

| 制作 robots.txt注意事项 ● 所有搜索引擎则用星号表示 ● Allow(允许)和Disallow(不允许)优先级 ● 至少屏蔽一个,可以屏蔽:搜索结果页面/404页面 ● 记得将sitemap放到Robots文件中 ● 可以陆续放入更多,而不是一次性决定所有 ● 网站后台地址/图片地址/下载文件地址/错误链接

本文的视频课程地址:https://ke.seowhy.com/play/9492.html 阅读本文的人还可以阅读: (编辑:泰州站长网) 【声明】本站内容均来自网络,其相关言论仅代表作者个人观点,不代表本站立场。若无意侵犯到您的权利,请及时与联系站长删除相关内容! |

推荐文章

站长推荐